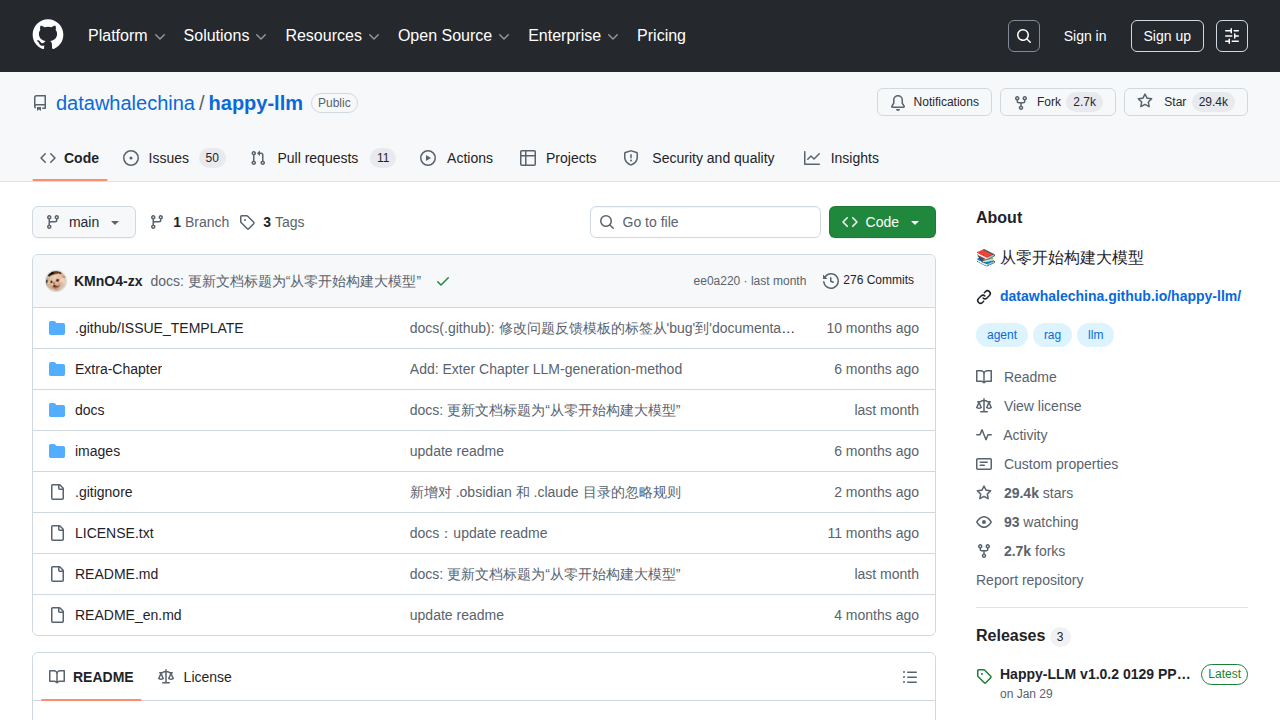

Datawhale 开源的系统性 LLM 学习教程,从 NLP 基础到动手搭建 LLaMA2,再到训练实践与 RAG/Agent 应用

项目简介

Datawhale 开源的系统性 LLM 学习教程,从 NLP 基础概念出发,逐步深入 Transformer 架构、预训练语言模型、大语言模型原理与训练,直到动手搭建并训练一个完整的 LLaMA2 模型。

内容结构

| 章节 | 关键内容 | 状态 |

|---|---|---|

| 第一章 NLP 基础概念 | 文本表示演进、任务分类 | ✅ |

| 第二章 Transformer 架构 | 注意力机制、手把手搭建 Transformer | ✅ |

| 第三章 预训练语言模型 | Encoder-only / Encoder-Decoder / Decoder-Only 对比 | ✅ |

| 第四章 大语言模型 | LLM 定义、训练策略、涌现能力 | ✅ |

| 第五章 动手搭建大模型 | 实现 LLaMA2、训练 Tokenizer、预训练小型 LLM | ✅ |

| 第六章 大模型训练实践 | 预训练、SFT、LoRA/QLoRA 高效微调 | 🚧 |

| 第七章 大模型应用 | 模型评测、RAG、Agent 智能体 | ✅ |

你将收获什么

- 深入理解 Transformer 架构和注意力机制

- 掌握预训练语言模型的基本原理

- 了解现有大模型的基本结构

- 动手实现一个完整的 LLaMA2 模型

- 掌握从预训练到微调的全流程

- 实战 RAG、Agent 等前沿技术

配套资源

- 在线阅读:https://datawhalechina.github.io/happy-llm/

- PDF 教程:Releases 页面免费下载

- PPT 讲义:配套教学课件

- 预训练模型:215M Base + SFT 版本(ModelScope)

- Extra Chapter:社区贡献的 LLM 学习笔记与 Blog

适合人群

大学生、研究人员、LLM 爱好者。建议具备 Python 基础和深度学习相关知识。

Stars

⭐ GitHub 29.4k+ | Datawhale 开源 | CC BY-NC-SA 4.0

暂无评论